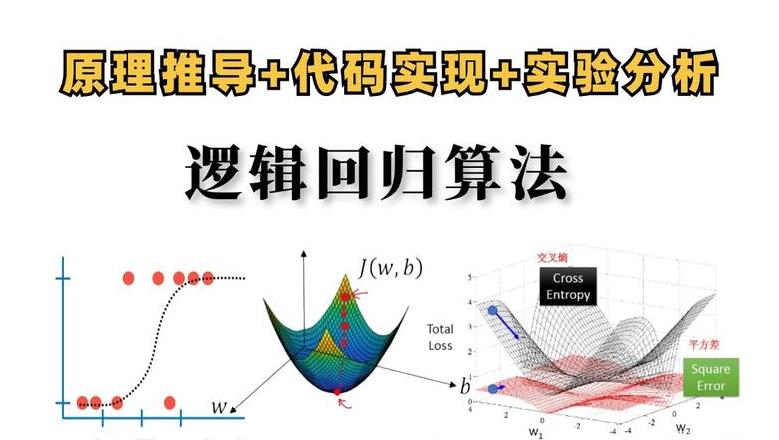

逻辑回归与决策树:分类问题中的算法对比

逻辑回归与决策树在分类上的一些区别

逻辑回归和决策树在分类上的一些区别

营销预测模型的许多目标变量是状态或类型,例如客户是否“购买”或“不购买”,以及客户如何选择访问互联网是“宽带”还是“拨号”,营销渠道是电子邮件、电话还是互联网。

我们把这类问题统称为“分类”。

决策树和逻辑回归都专门解决“分类”问题。

使用不同的算法来解决同一个问题,自然会引发关于哪种算法更好的讨论,但到目前为止,仍然没有明确的结论。

这是可以预料的,因为性能既取决于数据情况又取决于矿工的技能。

从算法本身来看,决策树和回归各有各的优点,因此最好的应用不是两者选其一,而是取其一,取其所长来弥补不足。

另一个。

在进一步讨论之前,让我们看一下逻辑回归和决策树之间的主要区别。

有些差异是微妙的,例如,决策树可以处理缺失值,而逻辑回归则要求矿工首先处理缺失数据。

但实际上,决策树还需要做出一定的假设并处理缺失值。

例如,当 CART 遇到变量缺失条件时,它会使用辅助变量进行替换和除法。

这种方法也可以在逻辑回归中执行,但需要单独编程。

在决策树中,这一步已经嵌入到软件算法引擎中。

基本上,决策树和逻辑回归的区别在于: 1.逻辑回归在分析数据的整体结构方面优于决策树,而决策树在分析局部结构方面优于逻辑回归。

2.逻辑回归擅长分析线性关系,而决策树不太能理解线性关系。

虽然处理非线性关系是决策树的主要强项,但很多非线性关系可以用线性关系来近似,而且效果非常好。

线性关系在实践中具有很多优点:简单、易于理解,并且可以在一定程度上防止数据出现极端情况。

3.逻辑回归对极值敏感,容易受极值影响,而决策树在这方面表现更好。

两者的区别主要来自于算法的逻辑。

由于决策树采用了切分的方法,因此可以深入到数据的细节,但同时却失去了对整体情况的认识。

一旦形成一层,它与其他层或节点的联系就被切断,进一步的挖掘只能在局部进行。

同时,由于分割,样本数量不断萎缩,因此无法支持多个变量的同时测试。

逻辑回归总是着眼于拟合整个数据,因此它对整体情况有更好的了解。

然而,它无法考虑本地数据,也没有探索本地结构的内部机制。

此外,逻辑回归和决策树之间存在一些应用差异。

与逻辑回归相比,决策树的结果稍微粗糙。

原则上,逻辑回归可以提供数据中每个观察点的概率,而决策树只能将挖掘对象划分为有限的概率组。

例如,如果决策树指定17个节点,则整个总体只能有17个概率,这在应用中受到一定的限制。

从操作上来说,决策树更容易启动,并且需要较少的数据预处理,而逻辑回归则需要一定的培训和技能。

对于两者之间的补充或改进,主要思想是利用决策树理解局部数据结构的优越能力来提高逻辑回归的有效性。

有几种具体方法,其中之一是从决策树分析中找出数据的局部结构,作为构建逻辑回归中的因变量(交互作用)的基础。

另一种方法是在需要预测变量离散化时使用决策树分析来确定最佳分割点。

另一种方法是用决策树分类的最终结果作为预测变量,与其他协变量一起代入回归模型,也称为“联合模型”。

理论上,移植模型结合了决策树和逻辑回归的优点。

端节点包含数据中重要的局部结构,协变量可以填充决策树遗漏的整个数据结构。

移植模型是一个非常巧妙的设计,但在实践中并没有得到普遍认可。

因为决策树对数据进行了最大拟合,所以协变量的空间很小。

换句话说,如果使用决策树的末端节点作为预测变量,则可能无法找到具有独立作用的协变量。

如果没有协变量,逻辑回归实际上只是决策树的迭代。

此外,由于节点是多个属性的组合,因此很难解释。

不清楚每个节点代表什么,从而限制了该方法的通用性。

以上是小编分享的关于逻辑回归和决策树在分类上的一些区别的相关,更多可以关注Global Ivy分享更多干货

分层回归是逻辑回归吗

不隶属。

逻辑回归是一种非线性概率回归,分为二类回归模型和多类回归模型。

理解层次回归实际上就是比较两个或多个回归模型。

汇总数据的逻辑回归模型也可以称为分层逻辑回归。

层次回归将主要研究变量放在模型的最后一步,在排除其他变量的贡献后检验该变量对回归方程的贡献。

如果该变量仍然做出显着贡献,则可以断定该变量具有其他变量无法替代的独特作用。

该方法主要用于自变量之间相关性较高,且难以确定单个自变量的独特贡献时。

它经常用于中介或调节研究。

概念

逻辑回归是一种广义的线性模型,因此它与多元线性回归分析有很多相似之处。

他们的模型本质上是一样的,都有w'x+b,其中w和b是待确定的参数。

区别在于它们的因变量不同。

多元线性回归直接使用w'x+b作为因变量,即w=w'x+b。

逻辑回归使用函数L将w'x+b拟合到隐藏状态p,p=L(w'x+b),然后根据p的大小和1 -p。

如果L是逻辑函数,则它是逻辑回归,如果L是多项式函数,则它是多项式回归。

逻辑回归的因变量可以是二元或多类,但二元分类更常见,并且可以使用softmax方法处理多类。

实践中应用最广泛的是二元逻辑回归。

逻辑回归包括分层回归吗

逻辑回归不包括层次回归。

层次回归和逻辑回归是两种不同的回归方法:

1. 逻辑回归

是指利用统计数学方法和概率论创建分类模型来预测给定变量的值在一定条件下为0或1的概率。

逻辑回归模型的输出结果是0或1的概率值或分类标签。

它是广义的线性模型,适合解决二元分类问题。

2. 分层回归

是一种用于解决分类和多线性问题的回归技术。

在层次回归中,分析人员根据样本的特征对样本进行划分,并将每个子集中的样本作为一个单独的回归问题进行回归分析,从而提高模型的准确性。

因此,虽然都是回归分析的方法,但逻辑回归和层次回归是两种不同的方法,不涉及关系。

二十世纪末以来,层次数据结构的层次模型在理论研究和应用方面都取得了重大进展。

该模型本质上是一个条件独立的层次模型。

多元Logistic回归模型简介:

1980年,Olson首先将Logistic回归方法引入金融危机预警领域。

他选择了1970年至1970年的时期。

使用1976年105家破产企业和2,058家非破产企业的配对样本来分析样本企业在破产概率期间的分布以及两类误差与破产概率之间的关系。

分割点。

逻辑回归:

事实证明,公司规模、资本结构、业绩和当前融资能力可以以96.12%的准确率预测金融危机。

逻辑回归分析方法为财务预警提供了显着的改进,克服了传统判别分析中的许多问题,包括假设变量属于正态分布以及破产和非破产企业具有相同协方差矩阵的假设。

在金融风险预测的研究中引入多元Logistic(逻辑)回归之后,金融危机的预测被简化为计算一个公司在一段时间内陷入金融危机的概率问题。

如果已知具有某些财务特征,则为一段时间。

如果计算出的概率大于规定的分界点,则判定公司存在财务风险。